- 品牌

- Nvidia

- 型號

- H100

- 磁盤陣列

- Raid10

- CPU類型

- Intel Platinum 8558 48 核

- CPU主頻

- 2.10

- 內存類型

- 64G

- 硬盤容量

- Samsung PM9A3 7.6TB NVMe *8

- 廠家

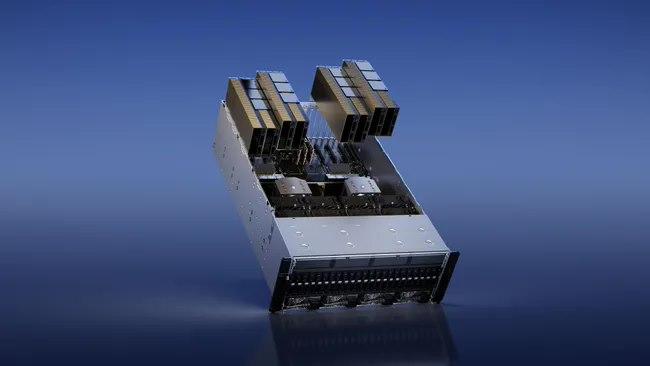

- SuperMicro

- 標配CPU個數

- 2個

- 最大CPU個數

- 4個

- 內存容量

- 64G*32

- GPU

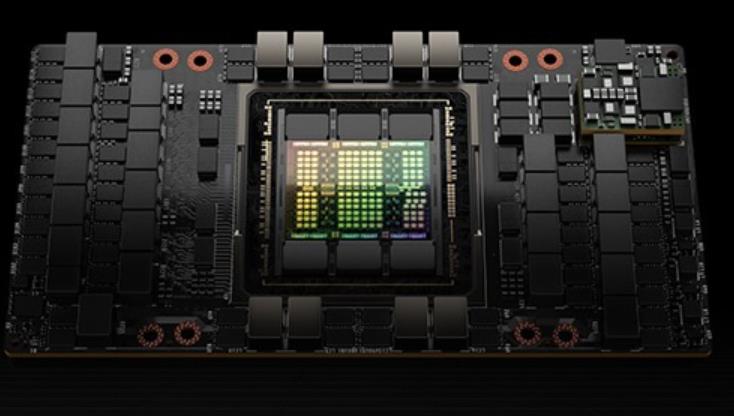

- 8 H100 80GB NVlink

在人工智能應用中,H100 GPU 的計算能力尤為突出。它能夠快速處理大量復雜的模型訓練和推理任務,大幅縮短開發時間。H100 GPU 的并行計算能力和高帶寬內存使其能夠處理更大規模的數據集和更復雜的模型結構,提升了AI模型的訓練效率和準確性。此外,H100 GPU 的高能效比和穩定性也為企業和研究機構節省了運營成本,是人工智能開發的理想選擇。對于科學計算而言,H100 GPU 提供了強大的計算能力。它能夠高效處候模擬、基因組學研究、天體物理學計算等復雜的科學任務。H100 GPU 的大規模并行處理單元和高帶寬內存可以提升計算效率和精度,使科學家能夠更快地獲得研究成果。其穩定性和可靠性也為長時間計算任務提供了堅實保障,是科學計算領域不可或缺的工具。H100 GPU 提供高效的技術支持。DubaiH100GPU

使用TSMC4nm工藝定制800億個晶體管,814mm2芯片面積。NVIDIAGraceHopperSuperchipCPU+GPU架構NVIDIAGraceCPU:利用ARM架構的靈活性,創建了從底層設計的CPU和服務器架構,用于加速計算。H100:通過NVIDIA的超高速片間互連與Grace配對,能提供900GB/s的帶寬,比PCIeGen5快了7倍目錄H100GPU主要特征基于H100的系統和板卡H100張量架構FP8數據格式用于加速動態規劃(“DynamicProgramming”)的DPX指令L1數據cache和共享內存結合H100GPU層次結構和異步性改進線程塊集群(ThreadBlockClusters)分布式共享內存(DSMEM)異步執行H100HBM和L2cache內存架構H100HBM3和HBM2eDRAM子系統H100L2cache內存子系統RAS特征第二代安全MIGTransformer引擎第四代NVLink和NVLink網絡第三代NVSwitch新的NVLink交換系統PCIeGen5安全性增強和保密計算H100video/IO特征H100GPU主要特征新的流式多處理器(StreamingMultiprocessor,SM)第四代張量:片間通信速率提高了6倍(包括單個SM加速、額外的SM數量、更高的時鐘);在等效數據類型上提供了2倍的矩陣乘加。MatrixMultiply-Accumulate,MMA)計算速率,相比于之前的16位浮點運算,使用新的FP8數據類型使速率提高了4倍。DubaiH100GPUH100 GPU 限時特惠,立刻搶購。

英偉達可以純粹提高價格以找到清算價格,并且在某種程度上正在這樣做。但重要的是要知道,終H100的分配取決于Nvidia更喜歡將分配分配給誰。供應H100顯卡#造成瓶頸的原因-供應生產方面的瓶頸是什么?哪些組件?誰生產它們?誰制造了H100?#臺積電。英偉達可以使用其他芯片廠進行H100生產嗎?#不是真的,至少現在還沒有。他們過去曾與三星合作過。但在H100和其他5nmGPU上,他們只使用臺積電。這意味著三星還不能滿足他們對前列GPU的需求。他們將來可能會與英特爾合作,并再次與三星合作,但這些都不會在短期內以有助于H100供應緊縮的方式發生。不同的臺積電節點如何關聯?#臺積電5nm系列:N5264N要么適合作為N5的增強版本,要么低于N5PN5P4N要么適合作為N5P的增強版本,要么低于N5作為N5的增強版本N4N4PH100是在哪個臺積電節點上制造的?#臺積電4N。這是Nvidia的一個特殊節點,它屬于5nm系列,并且是增強的5nm,而不是真正的4nm。還有誰使用該節點?#是蘋果,但他們主要轉向N3,并保留了大部分N3容量。高通和AMD是N5家族的其他大客戶。A100使用哪個臺積電節點?#N727晶圓廠產能通常提前多久預留?#不確定,雖然可能是12+個月。

H100 GPU 還集成了多種先進的安全和管理功能。例如,它支持 NVIDIA 的 GPU Direct 技術,能夠實現 GPU 之間的直接通信,減少了 CPU 參與的數據傳輸延遲,提升了數據傳輸效率。此外,H100 GPU 還支持多種虛擬化技術,如 NVIDIA vGPU,能夠在虛擬化環境中提供高性能的圖形和計算服務。其多樣化的管理和安全功能,使得 H100 GPU 在企業級數據中心和云計算平臺中具備了更高的適用性和管理便捷性。在能效方面,H100 GPU 也表現優異。其功耗設計為 400W,但在實際使用中,通過優化負載分配和動態電壓頻率調節(DVFS)技術,可以有效降低功耗,提高能效比。對于需要長時間運行的大規模計算任務,H100 GPU 的高能效設計不僅可以降低運營成本,還減少了對環境的影響。其先進的功耗管理技術確保了在提供高性能計算的同時,依然能夠保持較低的能源消耗。H100 GPU 提供高效的視頻編輯支持。

然后剩余的總共大約6個月。初創公司是否從OEM和經銷商處購買?#沒有。初創公司通常會去像甲骨文這樣的大型云租用訪問權限,或者像Lambda和CoreWeave這樣的私有云,或者與OEM和數據中心合作的提供商,如FluidStack。初創公司何時構建自己的數據中心與進行托管?#對于構建數據中心,考慮因素是構建數據中心的時間,您是否具有硬件方面的人員和經驗,以及它的資本支出是否昂貴。更容易租用和colo服務器。如果你想建立自己的DC,你必須在你所在的位置運行一條暗光纖線路來連接到互聯網-每公里10萬美元。大部分基礎設施已經在互聯網繁榮期間建成并支付。現在你可以租它,相當便宜–私有云執行官從租賃到擁有的范圍是:按需云(使用云服務的純租賃),保留云,colo(購買服務器,與提供商合作托管和管理服務器),自托管(自己購買和托管服務器)。大多數需要大量H100的初創公司將進行保留云或colo。大云如何比較?#人們認為,Oracle基礎架構不如三大云可靠。作為交換,甲骨文會提供更多的技術支持幫助和時間。100%.一大堆不滿意的客戶,哈哈–私有云執行官我認為[甲骨文]有更好的網絡–(不同)私有云高管一般來說,初創公司會選擇提供支持、價格和容量的佳組合的人。H100 GPU 特價供應,先到先得。belarusH100GPU一臺多少錢

H100 GPU 降價特惠,趕快搶購。DubaiH100GPU

網絡、存儲、RAM、CPU)以及銷售它的人的利潤率和支持級別。該范圍的**,包括支持在內的$360k-380k,是您可能期望與DGXH100相同規格的。1xHGXH100(PCIe)和8xH100GPU大約是300k美元,包括支持,具體取決于規格。PCIe卡的市場價格約為30k-32k美元。SXM卡并不是真正作為單張卡出售的,因此很難在那里給出定價。通常作為4-GPU和8-GPU服務器出售。大約70-80%的需求是SXMH100,其余的是PCIeH100。SXM部分的需求呈上升趨勢,因為PCIe卡是前幾個月***可用的卡。鑒于大多數公司購買8-GPUHGXH100(SXM),每360個H380的大約支出為8k-100k,包括其他服務器組件。DGXGH200(提醒一下,包含256xGH200,每個GH200包含1xH100GPU和1xGraceCPU)的成本可能在15mm-25mm之間-盡管這是一個猜測,而不是基于定價表。19需要多少個GPU?#GPT-4可能在10,000到25,000架A100之間接受過訓練。20Meta擁有大約21,000架A100,特斯拉擁有約7,000架A100,穩定AI擁有約5,000架A100。21獵鷹-40B在384架A100上進行了訓練。22Inflection使用3,500H100作為其。23順便說一句,到22月,我們有3k在運行。并且***運行超過5.<>k。——穆斯塔法·蘇萊曼(MustafaSuleyman)。DubaiH100GPU

- QatarH100GPU list price 2025-07-09

- HPEH100GPU how much 2025-07-08

- NVLINKH100GPU優惠 2025-07-08

- 湖北H100GPU 2025-07-08

- 40GH100GPU總代 2025-07-08

- SMXH100GPU discount 2025-07-04

- 北京H100GPU折扣 2025-07-04

- TaiwanH100GPU how much 2025-07-03

- Iran超微H100GPU 2025-07-03

- 深圳HPEH100GPU 2025-07-01

- 英偉達H100GPU how much 2025-07-01

- IranHPEH100GPU 2025-06-30